KI-Agenten zwischen Wirtschaft und Forschung

Wie gelingt der reflektierte Umgang mit autonom handelnden KI-Systemen, in der Wirtschaft und im Forschungsbetrieb?

FAZ-Gastbeitrag: Führung für KI-Agenten

Am 8. April 2026 erschien in der Frankfurter Allgemeinen Zeitung (S. 4) ein Gastbeitrag von Doris Weßels und Miriam Maibaum unter dem Titel „Führung für KI-Agenten".

Die zentrale Beobachtung

KI-Systeme entwickeln sich derzeit von reaktiven Chatbots hin zu autonomen Agenten, die eigenständig planen, Aufgaben ausführen und Entscheidungen vorbereiten. Das verändert Arbeitsverteilung, Verantwortung und die Anforderungen an Führungskräfte. Weßels und Maibaum sprechen von einer „leisen Kompetenzrevolution", die sich schrittweise in den Arbeitsalltag schiebt.

Newskilling: die Antwort auf die Deskilling-Angst

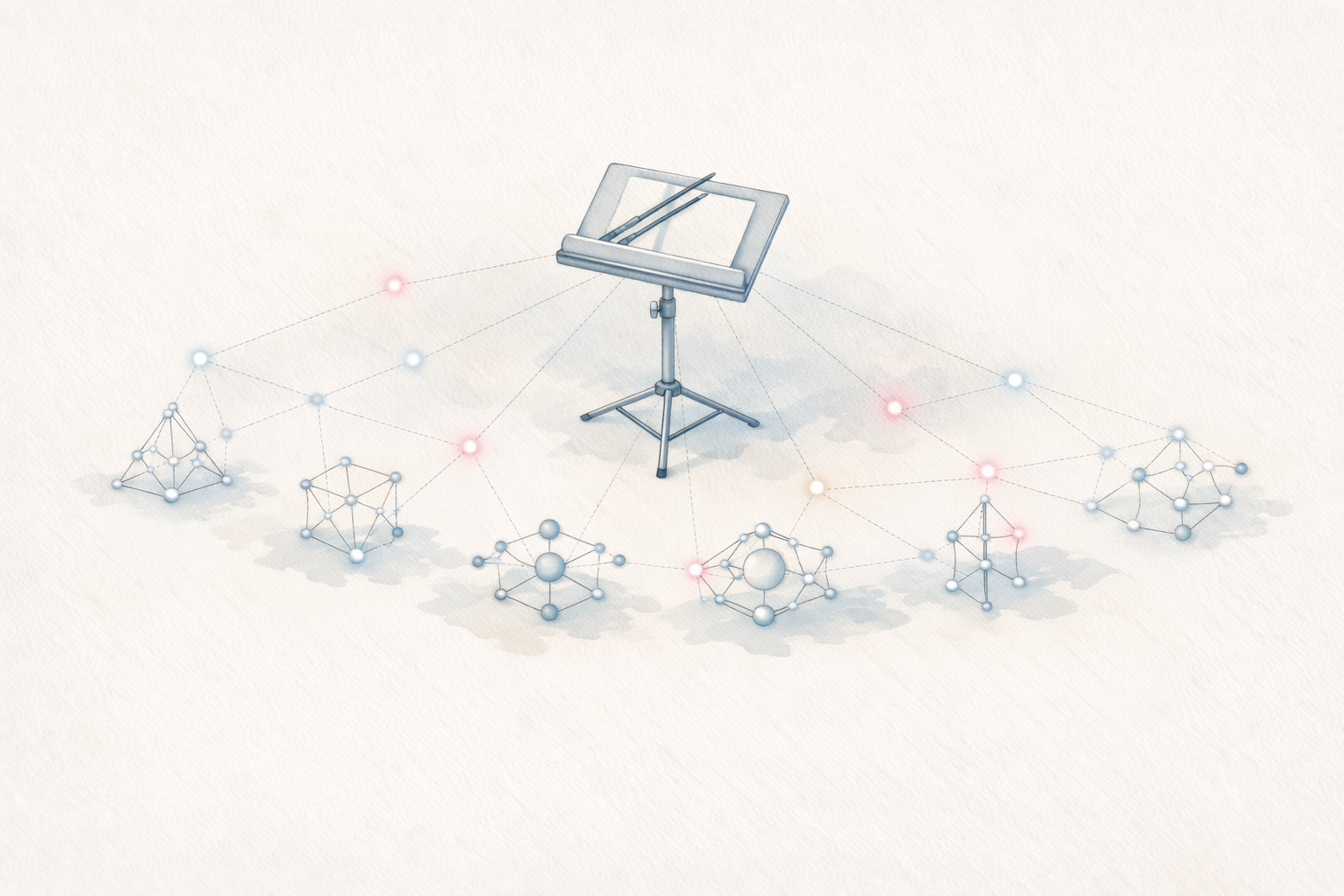

Die Autorinnen setzen dem verbreiteten Gedanken vom Kompetenzverlust durch KI das Konzept Newskilling entgegen. Gemeint sind Kompetenzen, die erst im Zusammenspiel von Mensch und KI-System entstehen und sichtbar werden. Dazu zählen die Fähigkeit, Ergebnisse von KI-Agenten präzise zu steuern, zu bewerten und zu orchestrieren, sowie die metakognitive Selbststeuerung: das aktive Reflektieren des eigenen Urteils in der Interaktion mit der Maschine.

Die Kernpunkte des FAZ-Beitrags

- Leise Kompetenzrevolution: Der Wandel kommt schrittweise, ist aber tiefgreifend.

- Von Chatbots zu Agenten: KI-Systeme planen, entscheiden und führen Aufgaben eigenständig aus.

- Newskilling statt Deskilling: Neue Kompetenzen entstehen gerade durch die enge Zusammenarbeit mit KI.

- AI Leadership: Führungskräfte brauchen die Fähigkeit, KI-Agenten wie quasi-autonome Mitarbeitende anzuleiten.

ZWM-Kolumne: „Zauberlehrlinge" in der Forschung

Zwei Tage nach dem FAZ-Beitrag verlagert Doris Weßels die Perspektive vom Wirtschaftsalltag in den Forschungsbetrieb. In ihrer ZWM-Kolumne „Innovationen im Wissenschaftsmanagement" in der DUZ Wissenschaft & Management 01|2026 fragt sie unter dem Titel „KI-Agentensysteme in der Forschung - geliebte oder bedrohliche ‚Zauberlehrlinge'?", wie Forschungsagenten den Wissenschaftsbetrieb verändern und welche Governance-Aufgaben daraus erwachsen.

Die Goethe-Anspielung steht ausdrücklich für ein Spannungsfeld von Magie und Kontrollverlust. Anders als der Lehrling beschwöre das heutige Wissenschaftsmanagement keine Besen zum Wasserholen, sondern KI-Agentensysteme, die eigenständig Hypothesen generieren, Experimente planen, gegebenenfalls durchführen und wissenschaftliche Publikationen verfassen sollen. Dieser Dynamik müsse sich das Wissenschaftsmanagement nicht erst morgen, sondern bereits heute stellen.

Beispiele aus der internationalen Forschung

Die Kolumne führt eine Reihe konkreter Entwicklungen an, die das Tempo des Wandels belegen:

- OpenAI kündigte an, bis 2028 vollautonome KI-Forscher zu entwickeln, die komplette wissenschaftliche Projekte selbstständig durchführen können.

- Google stellte mit dem „AI co-scientist" ein Multi-Agentensystem vor, das Hypothesen generiert, Literatur durchsucht und Forschungspläne erstellt.

- Japan investiert massiv in „Autonomous Labs", vollautomatisierte Labore, die von der Hypothese bis zur Publikation eigenständig arbeiten.

- Das IIT Delhi entwickelte mit deutscher und dänischer Beteiligung den KI-Agenten AILA, der Rasterkraftmikroskope autonom bedient und Tagesarbeit auf zehn Minuten verkürzt.

- Sakana.ai brachte im März 2025 mit dem „AI Scientist" die erste peer-reviewed Publikation eines KI-Agenten heraus; im Mai 2025 folgte der Agent „Zochi" mit einem Paper auf einer A*-Konferenz.

- Stanford richtete mit „Agents4Science" im Oktober 2025 die weltweit erste Konferenz aus, bei der KI-Autorenschaft erforderlich war und KI zugleich als Gutachter eingesetzt wurde.

Fundamentale Fragen für den Wissenschaftsbetrieb

Wenn ein KI-Agent in wenigen Minuten leistet, woran Forschende mehrere Monate arbeiten, stellen sich neue Grundfragen: Wie bewerten wir wissenschaftliche Leistung? Wer haftet für fehlerhafte KI-generierte Ergebnisse? Wie sichern wir Forschungsintegrität, wenn KI-Agenten autonom publizieren?

Hinzu kommen Infrastrukturfragen. Mit dem „Science Context Protocol (SCP)" aus Shanghai entsteht ein globales Netz autonomer Agenten mit über 1.600 integrierten Tools; mit Frameworks wie „Paper2Agent" werden Methoden aus Papern automatisch in interaktive Agenten überführt. Andrej Karpathy hat 2025 mit seinem „Reality Check" zur Vorsicht gemahnt: den Agenten fehlten noch Gedächtnis, Multimodalität und Robustheit. Spätestens dort, wo KI-Agenten als „virtuelle Mitarbeiter:innen" mit eigenen Accounts und Passwörtern in Forschungsnetzwerken auftauchen, treten Fragen der Cybersicherheit und Zugangskontrolle hinzu.

Die „Zauberlehrlinge" sind da. Anders als in Goethes Ballade wird kein Meister kommen und die Geister wieder bannen. Es liegt an uns, die neuen Potenziale zu nutzen und gleichzeitig die Risiken im Bann zu halten. Doris Weßels, ZWM-Kolumne / DUZ Wissenschaft & Management 01|2026

Daraus ergibt sich für Weßels eine klare Konsequenz: Die Bedeutung von KI-Governance ist sprunghaft gestiegen. Richtlinien für KI-generierte Forschung, abgestimmt mit Forschungsförderern wie der Deutschen Forschungsgemeinschaft und mit den Wissenschaftsverlagen, werden zur Pflichtaufgabe. Auch organisatorisch deutet sie an, wohin die Reise geht: Ein „AI-Literacy-Beauftragter" könnte zukünftig so selbstverständlich sein wie heute der Datenschutzbeauftragte. Die zentrale neue Führungskompetenz heißt: AI Leadership im agentischen Zeitalter.

Fünf Handlungsempfehlungen aus der Kolumne

- Pilotprojekte starten: Ausgewählte Forschungsagenten-Systeme in kontrollierten Umgebungen testen, um erste Erfahrungen zu sammeln.

- KI-Governance-Framework entwickeln: Mit allen relevanten Stakeholdern Richtlinien erarbeiten, mit besonderem Fokus auf Transparenzpflichten und Qualitätssicherung.

- KI-Kompetenzen fördern: Forschende und Verwaltung kontinuierlich im Umgang mit KI-Forschungsagenten qualifizieren.

- Infrastruktur prüfen: Evaluieren, welche Software-Lizenzen und Plattformen für KI-Systeme sinnvoll sind.

- Netzwerke nutzen: Austausch mit anderen nationalen und internationalen Forschungseinrichtungen.

Anknüpfungspunkte

Newskilling, AI Leadership und der praktische Umgang mit agentischen Systemen sind auch Themen unserer Arbeit im Zukunftslabor Generative KI, etwa in Promptathons, Machbarkeitsstudien und im ZGKI Change Framework. Dass diese Fragen Anfang April 2026 sowohl in einer überregionalen Tageszeitung als auch in einem Wissenschaftsmanagement-Magazin auftauchen, zeigt, wie schnell sich der Diskurs über autonome KI-Systeme über die Sektoren hinweg verbreitet.

Der volle Artikel ist hier zu finden: „KI-Agentensysteme in der Forschung - geliebte oder bedrohliche ‚Zauberlehrlinge'?" (PDF, ZWM Speyer).